夏乙出生于凹非寺

量子报道|公众号QbitAI

——猫戴着什么?

——帽子。

——的天气怎么样?

——下雨。

——披萨上面是什么?

——蘑菇。

看图回答这些问题对我们人类来说很容易,但要让AI掌握这个技能,就需要探索。

Facebook为了这一领域的探险家们,刚刚开放了一个叫Pythia的模块化视觉问答框架。

我们还将从弗吉尼亚理工大学和乔治亚理工大学举办的视觉测验(Visual Question Ansering )竞赛VQA Challenge开始演讲。

在比赛中,Facebook AI研究院(FAIR )队由A-STAR夺冠。 总成绩为72.41分位居第一,在(上图的是/否)、其他) Other ) 2类问题中也位居第一,分别获得87.7分和63.95分,数学) Number )成绩稍差,为51.51分、不合格、第6位

其他参加者可以回答“是/否”。 回答的数字不合格,但回答零散的其他问题也在及格线上徘徊。

根据冠军FAIR的观察,目前的视觉问答amp; a(vqa )模型有提问码、图像特征提取、回答空间分类这几个模块。

因此,他们希望为VQA领域构建一个简单的模块化模型开发平台。 另外,也可能可以用于看图对话。

构建平台的第一步是开放源代码A-STAR参与模式的基础框架Pythia,当前版本号v0.1。

奠定Pythia基础的,是2017年的vqa挑战冠军、Peter Anderson等人提出的Bottom-Up and Top-Down Attention模型。

Bottom-Up是指该模型以ResNet-101为基干网络,利用Visual Genome数据集事先训练好的Faster-RCNN,利用自下而上的注意机制提取图像特征。

另一方面,所谓Top-Down,是指根据问题(现在的任务)计算图像区域上的注意力分布。

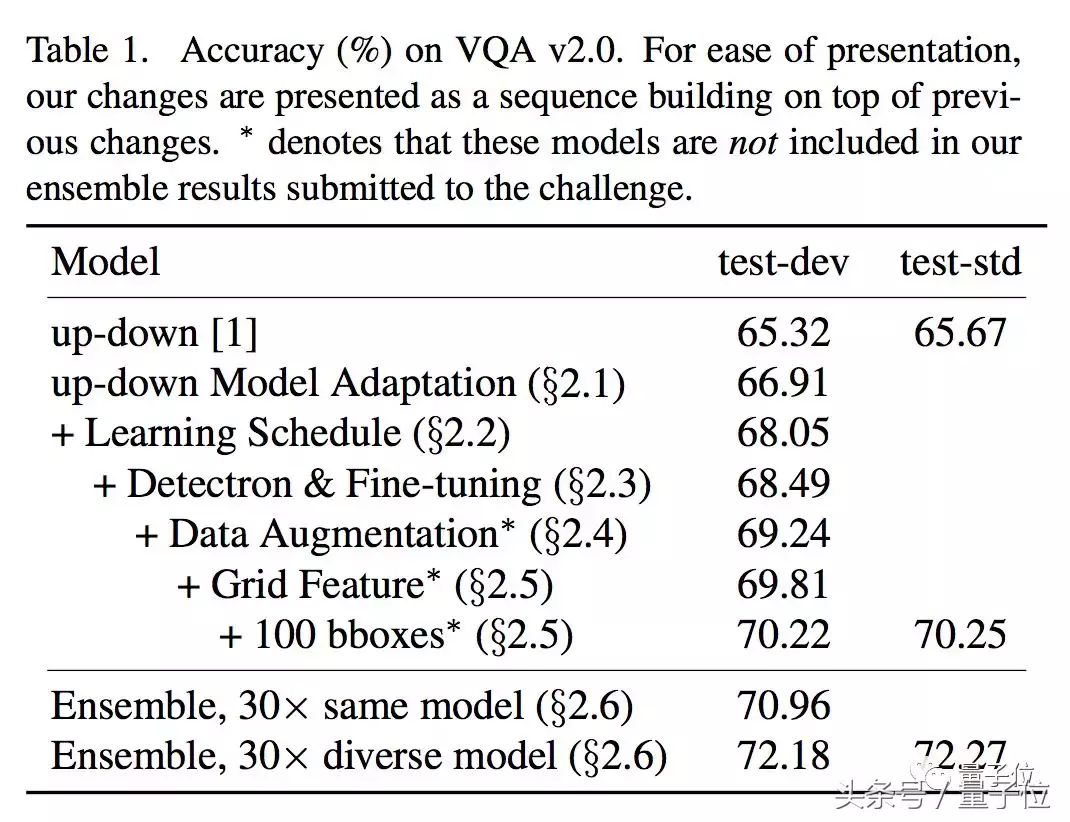

基于这个模型,FAIR团队进行了一些调整。

例如,用权重标准化ReLU代替up-down模型的双曲正切激活函数,用Adamax优化模型,增大学习率。 例如,将bottom-up模型的目标检测模型置换为Detectron的FPN,对所使用的数据集、Visual Genome、Visual Dialog等也进行了数据放大。

各模块的优化提高了模型的性能。

BTW,Facebook的参赛队伍和框架的名字没有深刻的含义。

队伍的名字——A-STAR的意思是,和星星没有太大关系,能够看、说、行动、推理的代理人(Agents that See,Talk,Act,and Reason )

帧名Pythia,也就是希腊神话中的皮蒂亚,德尔菲亚波罗神庙中的mmdgz。 mmdgz的重要工作之一是回答问题。

如果你也想做一个看图回答问题的模型,请收到这个paper :

pythiav 0.1: thewinningentrytothevqachallenge 2018

玉江,Vivek Natarajan,Xinlei Chen,Marcus Rohrbach,Dhruv Batra,Devi Parikh

359 Arxiv.org/pdf/1807.09956.pdf

开源代码:

359 Github.com /脸书研究/py thia

为其奠定基础的底部-向上和向下注意事项:

359 Github.com /增强园- Hu /底部-增强- vqa

结束了

认真招募

量子在招聘编辑/记者,工作地点在北京中关村。 期待有才华和热情的同学参加! 有关详细信息,请在量子位公众号(QbitAI )的对话界面中返回“招聘”两个字符。

量子比特QbitAI 头条号合同作者

' '跟踪AI技术和产品的新动态